1. Giriş: Kara Kutu Nedir?

“Kara kutu” terimi, bir sistemin iç işleyişinin dışarıdan gözlemlenemediği durumları tanımlar. Uçak motorları, yazılım sistemleri veya yapay zeka modelleri için sıklıkla kullanılır. Özellikle yapay zekâda kara kutu, algoritmanın nasıl ve neden belirli bir karar verdiğinin kullanıcı tarafından anlaşılmasının güçlüğüne işaret etmektedir.

Bu sorun yalnızca teknik bir mesele değildir; sosyal, etik ve hukuki sonuçları da vardır. Örneğin, bir işe alım yazılımı adayları değerlendirirken hangi kriterleri önemsediğini açıklayamıyorsa, sonuçlar şeffaflıktan yoksun hale gelir.

2. Yapay Zekâ ve Karar Mekanizması

Yapay zekâ sistemleri, özellikle derin öğrenme algoritmaları, milyonlarca veri noktasını işleyerek sonuç üretir. Bu süreçte algoritma karmaşık matematiksel işlemler ve veri bağlantıları kullanır.

• Veri girişi: Algoritmanın temel girdisi, geçmiş veri örnekleri ve öğrenme setleridir.

• Öğrenme süreci: Makine, örüntüleri ve ilişkileri kendi başına keşfeder.

• Çıktı üretimi: Karar veya tahmin, eğitim verileri ve öğrenme sürecine dayanır.

Ancak bu süreçlerin çoğu, insanlar için anlaşılması zordur. Matematiksel ağırlıklar, çok katmanlı nöral ağlar ve istatistiksel korelasyonlar, kararın görünmez olmasına yol açar. İşte tam bu noktada, yapay zekâ kara kutu hâline gelir.

3. Kara Kutu Probleminin Etkileri

3.1. Şeffaflık Eksikliği

Algoritmaların karar mantığı anlaşılmadığında, şeffaflık ortadan kalkar. Bu, özellikle kritik karar alanlarında risk oluşturur:

• Banka kredileri reddi

• İşe alım ve terfi kararları

• Hukuki tahmin sistemleri

3.2. Hesap Verebilirlik Sorunu

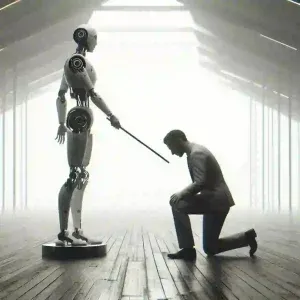

Bir yapay zekâ yanlış karar verdiğinde veya önyargılı sonuçlar ürettiğinde, kim sorumlu olacak? Soru belirsizleşir. Kara kutu, hesap verebilirliği sınırlayan başlıca faktördür.

3.3. Etik ve Sosyal Riskler

• Önyargılı veriler, algoritmanın hatalı veya adaletsiz kararlar üretmesine yol açabilir.

• Kara kutu, toplumsal güveni zedeler; insanlar “algoritma beni neden reddetti?” sorusunu sorar.

• İnsan kararlarının yerini alan otomatik sistemler, etik sorumluluk çerçevesinde şeffaflık talep eder.

4. Kara Kutunun Nedenleri

1. Veri karmaşıklığı: Büyük veri setlerinde ilişkiler gözle görülmez.

2. Algoritmanın kendi öğrenme süreci: Derin öğrenme, insan mantığıyla birebir açıklanamaz.

3. Gizlilik ve ticari sır: Algoritma iç yapısı şirketler tarafından saklanabilir.

Bu üç etmen bir araya geldiğinde, kararların neden alındığı ve hangi mantığa dayandığı tam olarak anlaşılamaz.

5. Çözüm Yöntemleri ve Yaklaşımlar

5.1. Açıklanabilir Yapay Zeka (Explainable AI – XAI)

• Algoritmanın mantığını şeffaf hâle getiren yaklaşımlar geliştirilmiştir.

• Karar süreci görselleştirilebilir, kritik noktalar kullanıcıya sunulabilir.

5.2. Denetim ve İnceleme

• Sistemler bağımsız kurumlarca denetlenebilir.

• Veri ve karar mantığı periyodik olarak gözden geçirilir.

5.3. Etik Kılavuzlar ve Düzenlemeler

• Yapay zekâ projelerinde etik standartlar ve yasal düzenlemeler belirlenmelidir.

• Kararların toplumsal etkisi önceden değerlendirilir.

6. Gelecek Perspektifi

Kara kutu problemini çözmek, sadece teknik bir hedef değil; aynı zamanda toplumsal güvenin yeniden inşasıdır. Açıklanabilir yapay zekâ, kullanıcıların kararları anlamasını sağlar ve algoritmanın sorumluluğunu görünür kılar.

Özetle, yapay zekâ kara kutusu, modern dijital çağın kritik bir sorunudur. Algoritmalar hayatın her alanına girmeye devam ederken, şeffaflık, hesap verebilirlik ve etik konuları daha da önem kazanacaktır.

Bir Cevap Yaz

E-posta adresiniz yayınlanmayacak. Gerekli alanlar * ile işaretlenmişlerdir.